728x90

반응형

SMALL

단순 선형 회귀 분석

입력 변수인 X의 정보를 활용하여 출력 변수인 Y를 예측하는 방법이다. 회귀 분석 중 간단한 방법으로 통계학에서 배우는 대부분의 회귀 모델은 선형 회귀, 딥러닝은 대표적인 비선형 회귀이다.

|

회귀 모델은 독립 변수에 따라 종류가 달라진다.

|

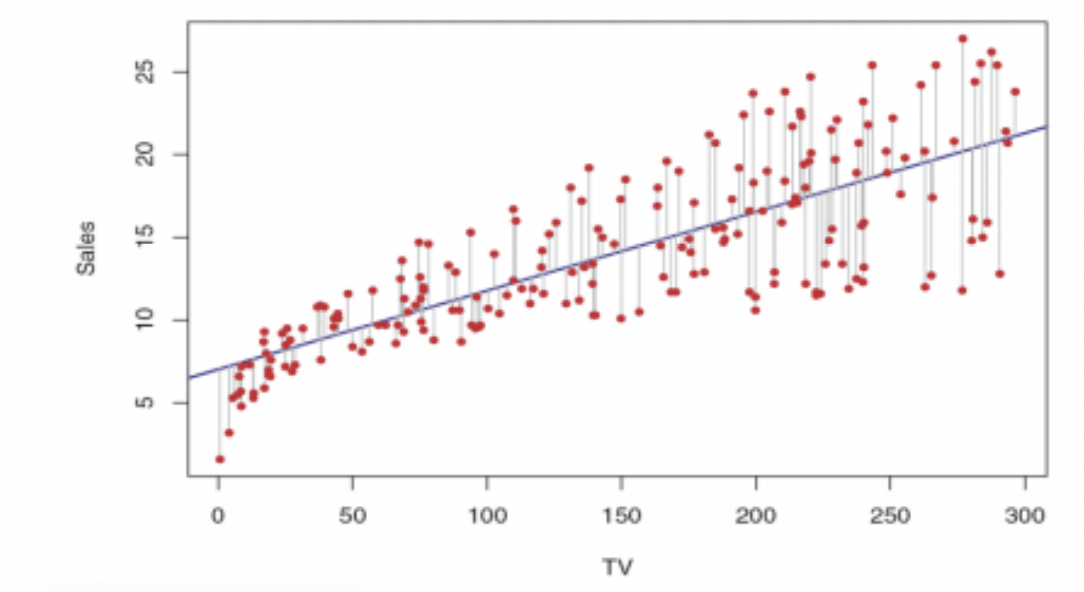

입력 변수가 X, 출력 변수가 Y일 때, 단순 선형 회귀의 회귀식은 검은 선으로 나타낼 수 있다. 𝛽0는 절편, 𝛽1은 기울기이며 합쳐서 회귀 계수 (coefficients)라고도 불린다.

단 X, Y는 선형 관계 일시 성립한다. |

추정 방법

|

|

|

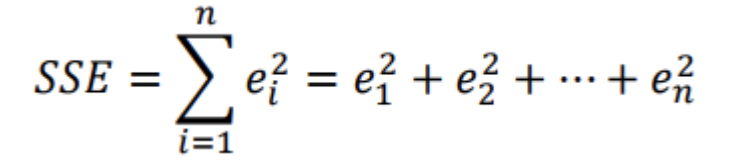

잔차의 제곱합을 최소화시키는 이유는 잔차의 합이 0이 되는 해는 무수히 많아 유일한 해를 찾지 못한다. 잔차의 절대값의 합은 미분이 불가능한 형태이며 잔차의 제곱 합은 미분이 가능한 형태로 유일한 해를 찾을 수 있다.

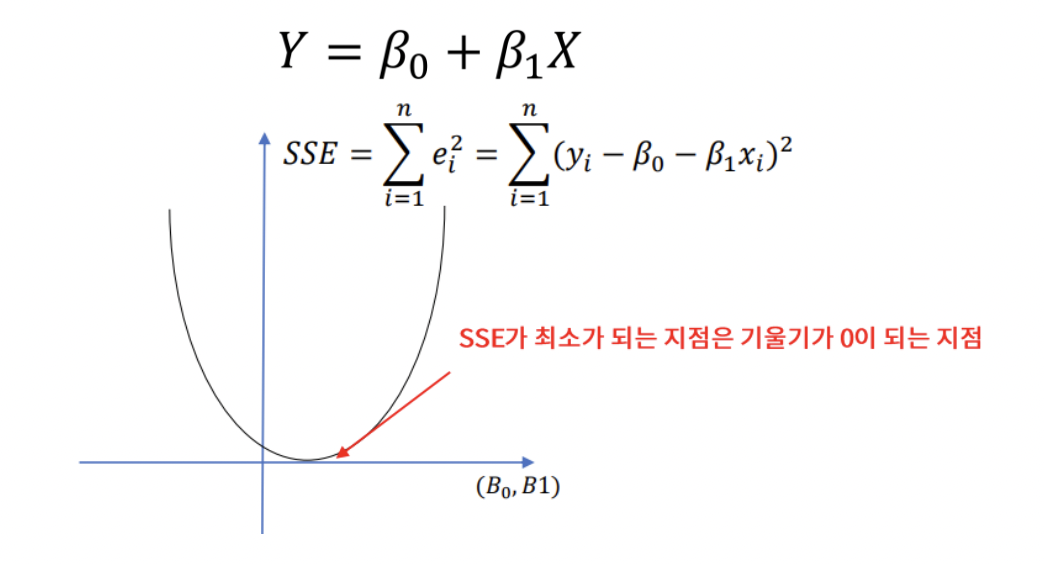

학습

잔차의 제곱의 값 (SSE)가 작아지도록 최적화 시키는 과정을 학습 (train)이라 한다. 데이터를 학습하면서 기울기와 절편의 값을 천천히 수정한다. 손실 함수를 미분하여 최소값을 찾을 수는 있으나 복잡도가 매우 커서 비효율적이다.

728x90

반응형

LIST

'Data-driven Methodology > DS (Data Science)' 카테고리의 다른 글

| [Data Science] Text Data (2) (0) | 2022.09.29 |

|---|---|

| [Data Science] Text Data (1) (0) | 2022.09.29 |

| [Data Science] 빅 데이터 (Big Data) (0) | 2022.09.28 |

| [Data Science] 의사결정 트리 (Decision Tree) (3) (0) | 2022.09.27 |

| [Data Science] 의사결정 트리 (Decision Tree) (2) (0) | 2022.09.27 |